Chez DialOnce, l’intelligence artificielle (IA) permet de comprendre et d’orienter chaque demande client avec précision.

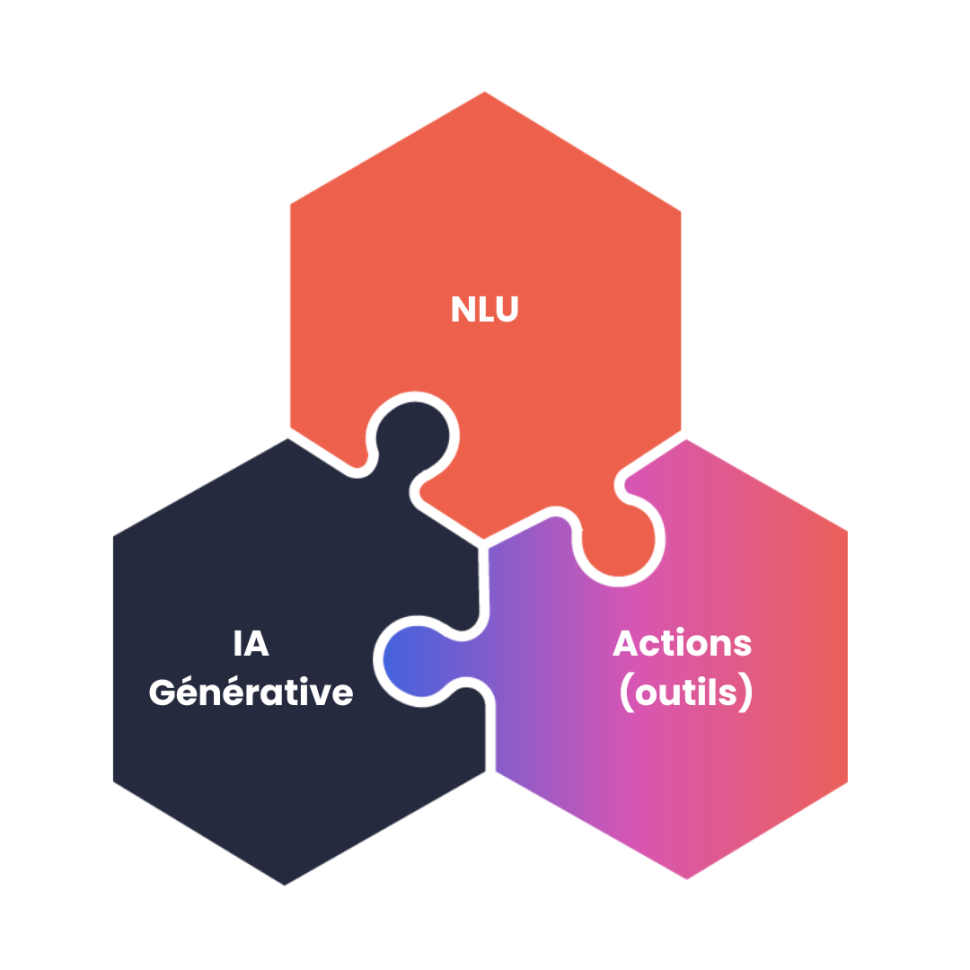

Nos moteurs conversationnels reposent sur une architecture hybride combinant la compréhension du langage naturel (NLU) et les modèles de langage (LLM) les plus performants du marché.

Cette approche propriétaire, que nous appelons Blend, associe la rigueur du NLU, pour identifier les intentions et les émotions, à la souplesse du LLM, pour formuler des réponses naturelles, précises et contextualisées.

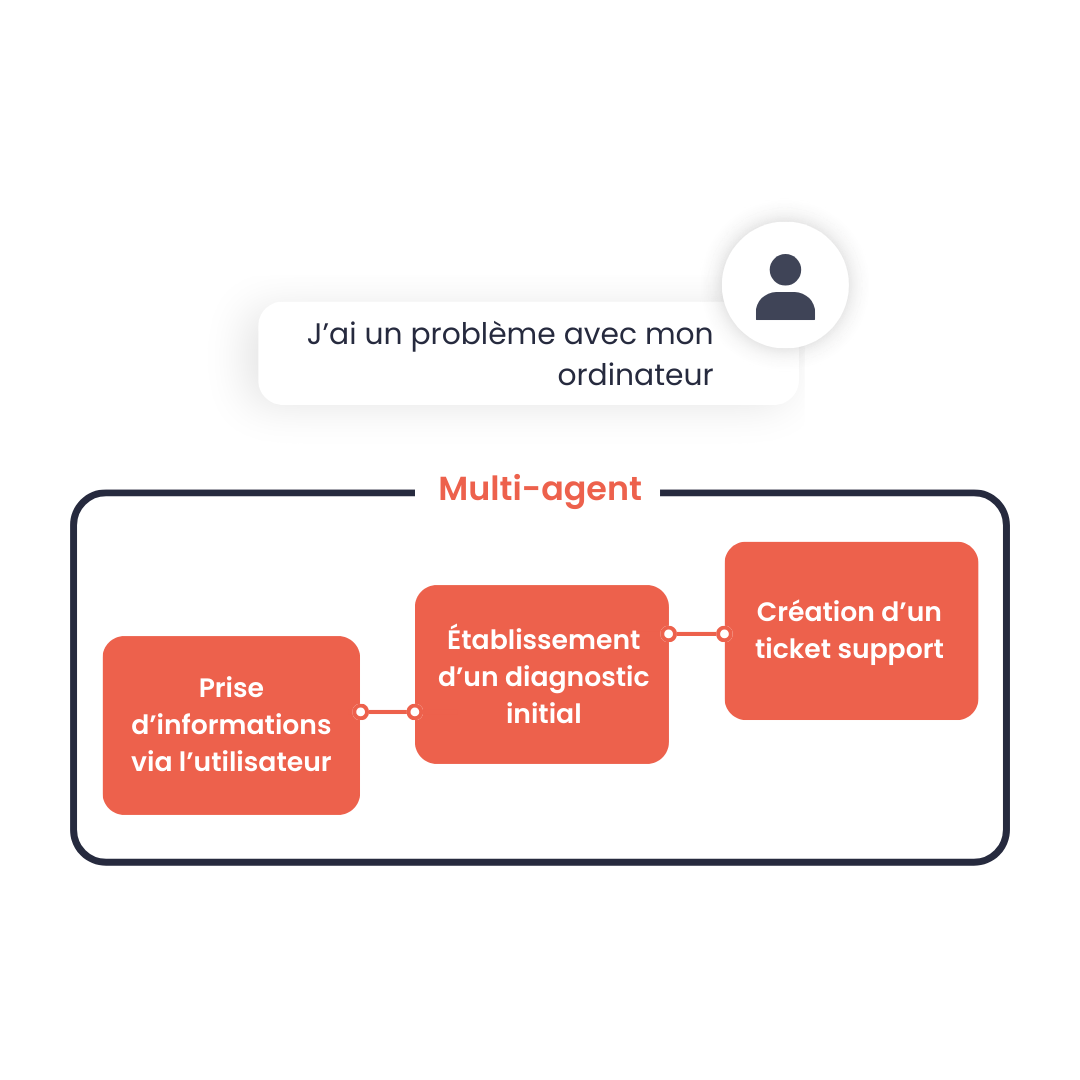

Le principal chantier d’évolution de DialOnce repose sur le passage à une architecture multi-agents, fondée sur deux piliers : A2A (Agent-to-Agent) et MCP (Model Context Protocol).

Un système multi-agents permet à plusieurs agents autonomes et spécialisés de collaborer et d’échanger des informations pour accomplir ensemble des tâches complexes.

Grâce au protocole A2A, les agents peuvent collaborer et échanger des informations entre eux, coordonnant ainsi leurs actions pour offrir une expérience fluide à l’utilisateur.

Le protocole MCP, quant à lui, leur permet d’interagir de manière sécurisée avec des systèmes tiers (CRM, outils métiers), en garantissant que chaque agent n’accède qu’aux données strictement nécessaires.

Cette évolution permettra à chaque étape de la conversation d’être prise en charge par un agent dédié, capable d’identifier une intention, de traiter une demande ou d’activer un outil métier. Par exemple, lors d’une création de ticket SAV, la conversation pourra être automatiquement transférée à l’agent spécialisé concerné, garantissant précision et continuité.

Cette architecture renforcera la pertinence et la fiabilité des interactions, tout en posant les bases d’un écosystème d’IA inter-opérable, sécurisée et de confiance.

L’IA de DialOnce repose sur trois principes essentiels : transparence, supervision humaine et conformité.

Notre solution intègre le concept du “LLM as a Judge” : un agent IA (chatbot IA nouvelle génération) configuré en tant que juge, chargé d’évaluer a posteriori la qualité des interactions selon plusieurs indicateurs clés : taux de résolution, satisfaction utilisateur et exactitude des réponses.

Cet agent examine régulièrement un échantillon représentatif des conversations (environ 10 %) pour identifier celles qui n’ont pas atteint les résultats attendus ou ont généré de l’insatisfaction.

Mais son rôle ne se limite pas à l’analyse : il participe activement à l’amélioration continue de la solution. À partir des tendances observées, il génère des recommandations automatiques pour optimiser les parcours conversationnels, les formulations de réponse ou la logique de routage.

Les insights collectés alimentent ensuite une boucle d’amélioration conjointe, partagée entre nos équipes et celles de nos clients lors des retours d’expérience et comités de pilotage.

Ce travail collaboratif assure une IA évolutive et contextualisée, capable de s’adapter aux usages, aux environnements et aux objectifs métier réels.